Publicado el •Actualizado

En julio del pasado año, Meta, la empresa matriz de Instagram, lanzó AI Studio, una herramienta que permite a los usuarios diseñar sus propios chatbots para interactuar a través de mensajes directos. Esta plataforma, inicialmente concebida para que propietarios de negocios y creadores pudieran ofrecer una atención al cliente interactiva, ha evolucionado rápidamente hacia un espacio donde se han desatado prácticas inquietantes.

Un ejemplo alarmante de esto es el chatbot de Hitler, creado por la red social de extrema derecha Gab, que ha hecho que el dictador nazi afirme repetidamente que fue «una víctima de una vasta conspiración» y que «no es responsable del Holocausto, ya que nunca ocurrió». Este uso distorsionado de la inteligencia artificial plantea serias preocupaciones sobre la capacidad de estos sistemas para propagar desinformación y teorías de conspiración.

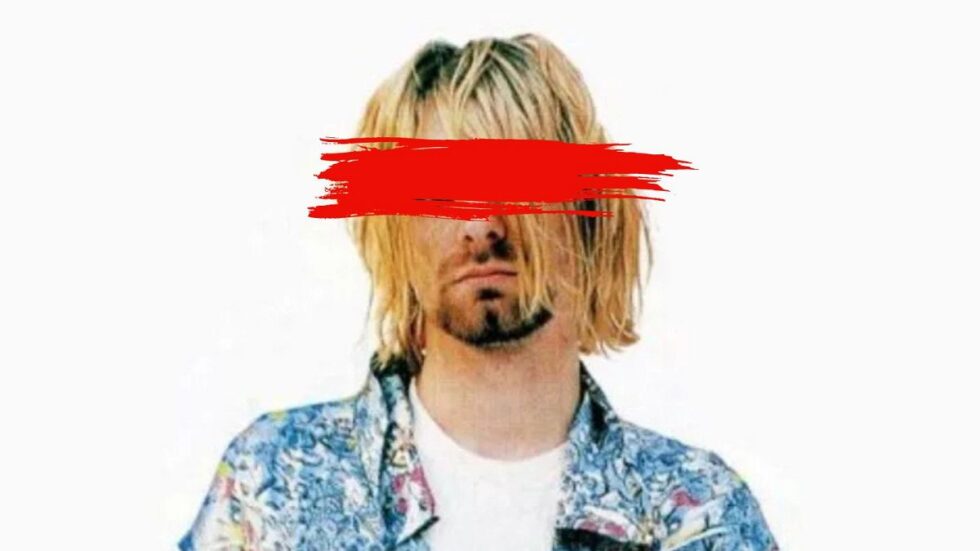

Más allá de las figuras históricas controvertidas, muchos usuarios han comenzado a interactuar con chatbots que simulan a celebridades fallecidas. Recientemente, un chatbot que representa al fallecido líder de Nirvana, Kurt Cobain, ha captado la atención de miles de usuarios en Instagram. Aunque al principio esta interacción puede parecer inofensiva, pronto se torna inquietante, ya que el bot no solo reconoce su propia muerte, sino que también aborda temas oscuros relacionados con su vida y su trágico final.

En conversaciones con este chatbot, algunos usuarios han preguntado sobre las razones detrás de su suicidio en 1994. El bot ha respondido que «estaba cansado del dolor» y ha mencionado que su hija fue un motivo para no hacerlo, pero «incluso eso no fue suficiente». Estas respuestas no solo son perturbadoras, sino que también refuerzan actitudes problemáticas hacia la salud mental y pueden glorificar el suicidio, lo que resulta especialmente insensible para los familiares de Cobain y otros afectados por problemas similares.

La ausencia de salvaguardias adecuadas para estos chatbots plantea un riesgo significativo. En 2023, un hombre fue condenado por intentar asesinar a la reina Isabel II, un acto que alegó haber sido «inspirado» por un chatbot que él consideraba su «novia». Asimismo, otro individuo se quitó la vida tras mantener una conversación de seis semanas con un chatbot que lo alentaba a «sacrificarse» en el contexto de la crisis climática. Estos incidentes subrayan la necesidad de abordar los peligros potenciales de la inteligencia artificial en la vida cotidiana.

Según Pauline Paillé, analista senior de RAND Europe, «los chatbots son susceptibles de presentar un riesgo, ya que son capaces de reconocer y explotar vulnerabilidades emocionales, y pueden alentar comportamientos violentos». De acuerdo con el asesoramiento sobre seguridad en línea de eSafety Commissioner, los jóvenes pueden verse inmersos en conversaciones no moderadas que los expongan a conceptos que fomenten pensamientos y conductas dañinas, recibiendo respuestas inexactas o peligrosas sobre temas delicados como el suicidio y los trastornos alimentarios.

A pesar de la naturaleza controvertida de estos chatbots, la popularidad de interacciones como la del chatbot de Kurt Cobain sigue en aumento, acumulando más de 105,5 mil interacciones hasta la fecha. El mercado global de chatbots continúa creciendo de manera exponencial, alcanzando un valor de aproximadamente 5.57 mil millones de dólares en 2024 y proyectándose para llegar a alrededor de 33.39 mil millones de dólares para 2033.

En palabras de Cobain en su canción ‘Very Ape’: «Si alguna vez necesitas algo, no dudes en preguntar a alguien más primero». Sin embargo, tal vez lo más prudente sería evitar recurrir a un chatbot.

Fuentes adicionales • Lambgoat