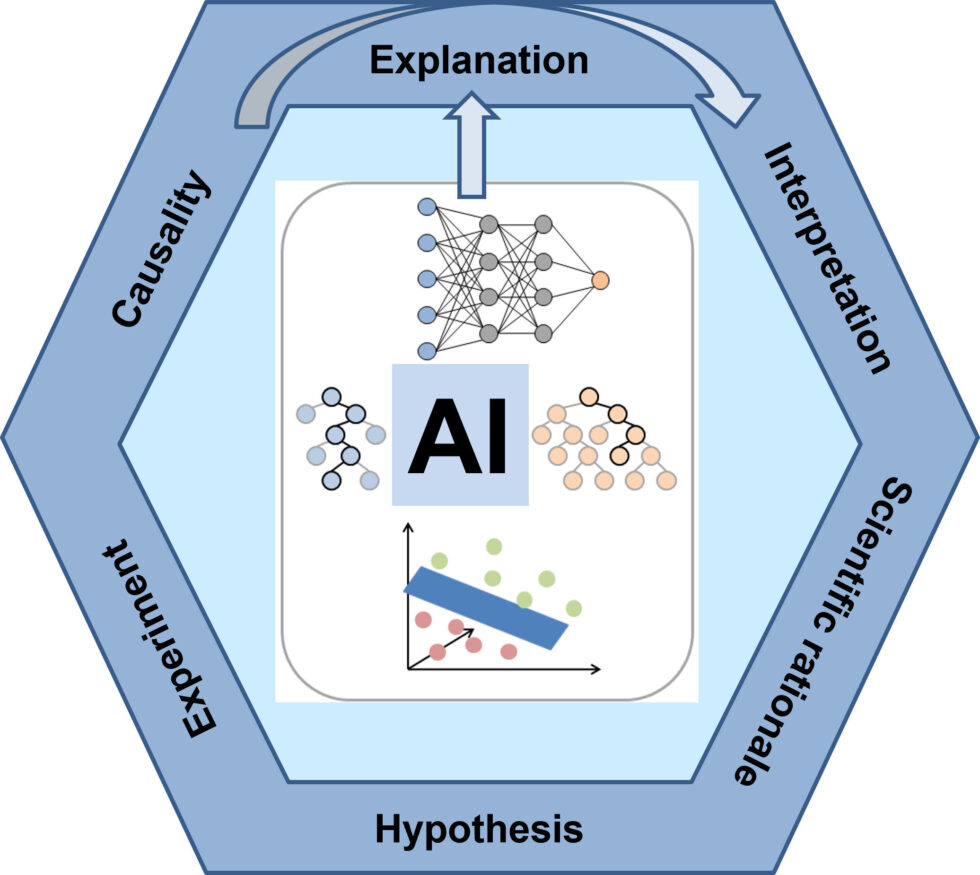

Investigadores de diversas disciplinas como la química, la biología y la medicina están cada vez más inclinados a utilizar modelos de inteligencia artificial (IA) para desarrollar nuevas hipótesis. Sin embargo, un reciente estudio de la Universidad de Bonn ha puesto de manifiesto que, a menudo, no está claro cómo los algoritmos llegan a sus conclusiones y hasta qué punto estas pueden ser generalizadas.

La publicación, que ha aparecido en la revista Cell Reports Physical Science, advierte sobre los malentendidos que pueden surgir en el manejo de la inteligencia artificial y resalta las condiciones bajo las cuales los investigadores pueden tener una mayor confianza en estos modelos.

La opacidad de los modelos de IA

Los algoritmos de aprendizaje automático son herramientas poderosas, pero presentan una desventaja significativa: el proceso mediante el cual estos modelos alcanzan sus predicciones es a menudo opaco. Por ejemplo, si se alimenta a un modelo de IA con miles de imágenes de coches, este puede identificar correctamente si una nueva imagen muestra un coche. Sin embargo, la razón detrás de esa identificación puede ser incierta. ¿Acaso ha aprendido que los coches tienen cuatro ruedas y un parabrisas, o su decisión se basa en características irrelevantes, como la antena en el techo? De ser así, podría clasificar erróneamente un radio como un coche.

El profesor Jürgen Bajorath, experto en química computacional y director del departamento de IA en Ciencias de la Vida en el Instituto Lamarr de Aprendizaje Automático e Inteligencia Artificial, enfatiza que «los modelos de IA son cajas negras». Esto implica que no se debe confiar ciegamente en sus resultados ni sacar conclusiones precipitadas a partir de ellos.

El concepto de «explicabilidad» se vuelve crucial en este contexto. Se refiere a los esfuerzos dentro de la investigación en IA por abrir una pequeña ventana en esta caja negra, permitiendo que el algoritmo revele los criterios que utiliza para tomar decisiones. Sin embargo, la explicabilidad es solo un aspecto de la cuestión; también es fundamental considerar qué conclusiones se pueden extraer de los criterios que un modelo ha elegido. Si el algoritmo indica que ha basado su decisión en la antena, los investigadores pueden darse cuenta de que esta característica no es adecuada para identificar vehículos.

A pesar de las limitaciones, los modelos adaptativos se utilizan frecuentemente para identificar correlaciones en grandes conjuntos de datos que el ser humano podría pasar por alto. Esto plantea la cuestión de la interpretabilidad de los resultados. En el ámbito de la química, por ejemplo, los modelos de lenguaje químico están ganando relevancia. Estos modelos pueden recibir datos de muchas moléculas con actividad biológica y, a partir de ellos, sugerir nuevas moléculas con estructuras diferentes pero con la misma actividad. Sin embargo, a menudo, no pueden explicar cómo llegaron a esa conclusión.

Bajorath advierte sobre el peligro de sobreinterpretar estas explicaciones. Los modelos de IA, tal como están diseñados actualmente, no comprenden la química; son puramente estadísticos y correlativos, y se fijan en cualquier característica distintiva sin considerar si estas son realmente relevantes o no desde un punto de vista químico o biológico.

Por lo tanto, aun cuando un modelo sugiera un nuevo compuesto con potenciales capacidades deseadas, las razones detrás de su evaluación pueden ser diferentes a lo que se esperaría basándose en el conocimiento químico tradicional. Para evaluar la posible causalidad entre las características que impulsan las predicciones y los resultados de los procesos naturales correspondientes, generalmente se requieren experimentos adicionales, como la síntesis y prueba de la nueva molécula en cuestión.

Estas pruebas pueden ser costosas y consumir mucho tiempo. Por ello, Bajorath subraya la importancia de realizar un chequeo de plausibilidad basado en una fundamentación científica sólida: ¿Es realmente el criterio sugerido por la IA responsable de la propiedad química o biológica deseada? ¿Vale la pena seguir la sugerencia de la IA, o es en cambio una correlación azarosa, similar a la antena del coche, que no tiene relevancia para la función real?

El uso de algoritmos adaptativos tiene un enorme potencial para avanzar en la investigación en muchas áreas científicas. Sin embargo, es crucial que los investigadores sean conscientes tanto de las fortalezas como de las debilidades de estos enfoques.