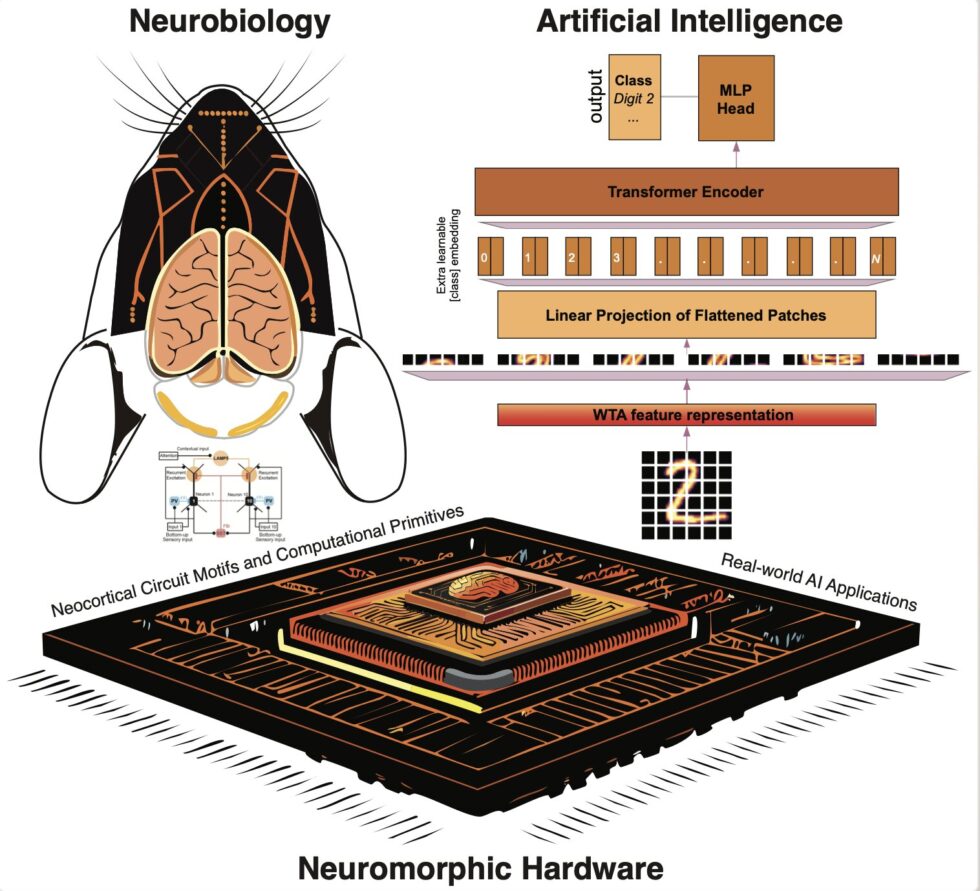

Un nuevo enfoque en inteligencia artificial inspirado en el neocortex

En la última década, el desarrollo de técnicas computacionales avanzadas ha permitido a los científicos informáticos abordar tareas del mundo real con una precisión comparable a la humana. Sin embargo, muchos de estos modelos de inteligencia artificial (IA) no replican de manera precisa los cálculos realizados por el cerebro humano. Investigadores de Tibbling Technologies, el Broad Institute de la Universidad de Harvard, la Universidad Nacional Australiana y otras instituciones han explorado la posibilidad de utilizar la IA para imitar un tipo específico de cálculo llevado a cabo por los circuitos del neocortex, conocido como «winner-take-all» (WTA), que se manifiesta cuando una o pocas neuronas dentro de un conjunto influyen en el resultado de un cálculo.

En su trabajo, publicado en el servidor de preprints bioRxiv, los investigadores han logrado emular con éxito este tipo de cálculo y han demostrado que su integración en modelos basados en transformadores puede mejorar significativamente su rendimiento en tareas de clasificación de imágenes. Asim Iqbal, primer autor del estudio, destacó que el objetivo principal era inspirarse en cómo el cerebro procesa la información para aplicar esos principios en la mejora de los sistemas de IA, centrándose en el cálculo WTA como una operación fundamental en los circuitos corticales. Este mecanismo biológico permite que las neuronas más activas supriman la actividad de otras, convirtiéndose en las únicas responsables de una decisión o cálculo específico.

Iqbal y su equipo se propusieron replicar con realismo este cálculo biológico utilizando hardware neuromórfico, específicamente el chip TrueNorth de IBM, diseñado para imitar la organización del cerebro. El modelo de red biofísica desarrollado se enfoca en las interacciones entre neuronas excitatorias y varios tipos de neuronas inhibitorias, incorporando propiedades medidas experimentalmente de estas células en la corteza visual. Este enfoque permite realizar cálculos de «winner-take-all» suaves, donde las entradas más fuertes se amplifican mientras que las más débiles son suprimidas, mejorando así la señal y filtrando el ruido. Los resultados mostraron mejoras significativas en el rendimiento de modelos de aprendizaje profundo, como los Vision Transformers, que se volvieron más capaces de generalizar a nuevos tipos de datos no entrenados, un desafío clave en la inteligencia artificial. La investigación abre la puerta a la aplicación de estos principios a sistemas de IA en diversas áreas, incluyendo visión por computadora, análisis de imágenes médicas y vehículos autónomos, y plantea la posibilidad de abordar tareas cognitivas complejas en el futuro.