Reducción de sesgos en modelos de inteligencia artificial

Los modelos de aprendizaje automático a menudo enfrentan problemas al realizar predicciones para individuos que no están adecuadamente representados en los conjuntos de datos utilizados para su entrenamiento. Un ejemplo típico se observa en modelos diseñados para predecir el mejor tratamiento para enfermedades crónicas, que pueden estar entrenados principalmente con datos de pacientes masculinos. Al aplicarse estos modelos en entornos hospitalarios, es probable que generen predicciones erróneas para pacientes femeninos, lo que refleja una importante limitación en su utilidad.

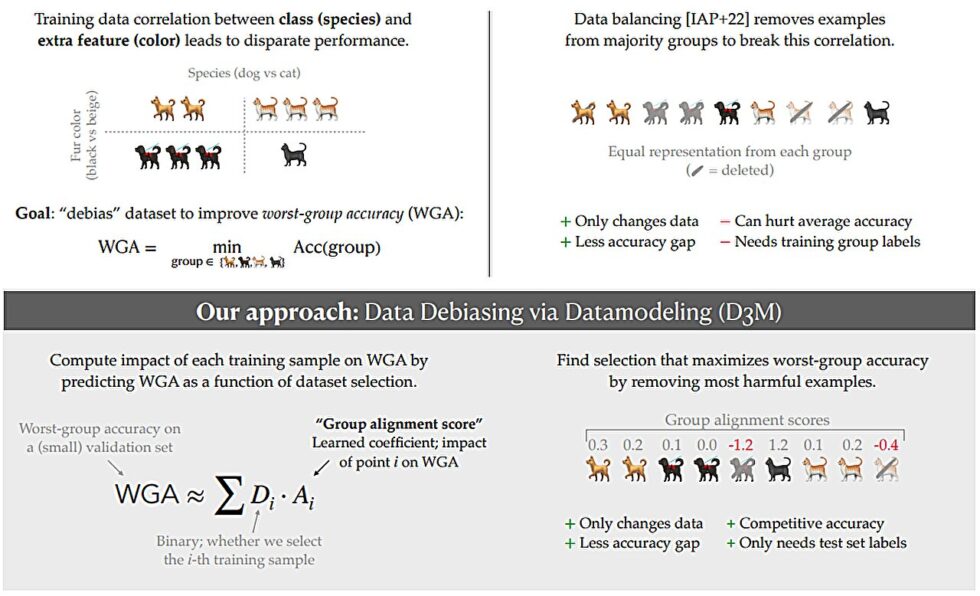

Con el fin de mejorar estos resultados, los ingenieros suelen intentar equilibrar los conjuntos de datos de entrenamiento, eliminando datos hasta que todos los subgrupos estén representados de manera equitativa. Sin embargo, este enfoque puede resultar problemático, ya que frecuentemente implica la eliminación de grandes cantidades de información, lo que podría perjudicar el rendimiento general del modelo. Investigadores del Instituto Tecnológico de Massachusetts (MIT) han desarrollado una nueva técnica que identifica y elimina de manera más eficiente aquellos puntos en el conjunto de datos que contribuyen a los fallos del modelo en subgrupos minoritarios. Al hacerlo, la técnica logra mantener la precisión general del modelo mientras mejora su rendimiento en estos grupos subrepresentados.

La metodología propuesta no solo se centra en la eliminación de datos problemáticos, sino que también es capaz de identificar fuentes ocultas de sesgo en conjuntos de datos desprovistos de etiquetas. Este enfoque se vuelve especialmente relevante dado que, en muchas aplicaciones, los datos no etiquetados son más comunes que aquellos que sí lo están. Por tanto, esta técnica podría ser combinada con otros métodos para mejorar la equidad de los modelos de aprendizaje automático en situaciones críticas. Los investigadores esperan que su trabajo, que se presentará en la Conferencia sobre Sistemas de Procesamiento de Información Neural (NeurIPS 2024) en Vancouver, contribuya a asegurar que los pacientes subrepresentados no sean mal diagnosticados debido a modelos de inteligencia artificial sesgados.